2020年全球可信人工智能行業發展現狀、建議與未來展望

人工智能(AI)正以前所未有的深度和廣度融入全球經濟與社會運行的各個層面,其可信度問題也日益成為全球關注的焦點。2020年,全球可信人工智能行業在機遇與挑戰中發展演進,展現出鮮明的特征與趨勢。本文將探討2020年全球可信人工智能行業的發展現狀,提出相應建議,并展望未來打造可信任人工智能系統及其行業應用系統集成服務的發展路徑。

一、2020年全球可信人工智能行業發展現狀

- 政策與法規框架初步構建:2020年,全球主要經濟體加速推進AI治理。歐盟發布《人工智能白皮書》,提出基于風險的監管框架,強調“可信AI”的七個關鍵要求(如人的能動性與監督、技術穩健性與安全等)。美國、中國、新加坡等國家也相繼發布或更新了國家AI戰略,均將安全、可靠、可控、公平等可信屬性置于核心地位。行業自律與標準制定同步推進,IEEE、ISO等國際標準組織加緊研制AI倫理與可信標準。

- 技術研發聚焦可信屬性:產業界與學術界的研究重點,從單純追求性能,擴展到確保AI系統的公平性、可解釋性、魯棒性和隱私保護。可解釋AI(XAI)、聯邦學習、差分隱私、對抗性樣本防御等技術得到廣泛研究與初步應用。企業在產品開發中開始系統性地引入偏見檢測、算法審計等工具。

- 行業應用探索與挑戰并存:可信AI的理念在金融、醫療、自動駕駛、司法等高風險領域率先落地。例如,金融機構利用可解釋模型進行信貸審批以減少歧視,醫療AI強調臨床驗證與責任界定。挑戰依然嚴峻:技術成熟度有待提高(如復雜模型的完全可解釋性仍是難題);部署成本增加;跨文化、跨區域的倫理共識難以統一;以及“可信”評估缺乏統一、量化的標準。

- 公眾信任成為關鍵制約:一系列AI安全事故和倫理爭議,加劇了公眾對AI的疑慮。建立并維持用戶信任,已成為AI技術被廣泛采納和創造價值的前提。企業不僅需要技術合規,更需通過透明溝通和責任機制來贏得信任。

二、推動可信人工智能發展的建議

- 構建敏捷、協同的治理體系:建議政府機構采取“敏捷治理”模式,結合強制性法規與柔性指南,建立動態更新的規則框架。加強跨國、跨部門的協同,在核心原則上尋求共識,同時尊重地域與文化差異。鼓勵采用“監管沙盒”等機制,在可控環境中促進創新。

- 加大核心技術攻關與標準化:持續投入資源,攻克可解釋性、公平性、魯棒性、隱私計算等方面的基礎技術瓶頸。加速推進可信AI的評估標準、測試基準和認證體系的國際國內互認,為行業提供清晰、可操作的指引。

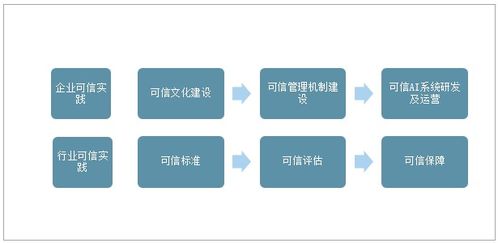

- 推行全生命周期可信管理:倡導并推動企業將可信原則嵌入AI系統的整個生命周期——從數據收集、模型設計、訓練驗證,到部署運營、監控與退役。建立企業內部AI倫理審查委員會或類似機制,實施常態化算法影響評估。

- 培育人才與生態,提升公眾認知:加強跨學科(計算機科學、法律、倫理、社會學)AI治理人才的培養。通過行業聯盟、開源項目、最佳實踐分享,共建可信AI生態。開展公眾科普與對話,提高社會對AI技術的理性認知和參與度。

三、未來展望:打造可信任的人工智能系統與集成服務

可信將從AI的“附加屬性”轉變為“核心基礎”。打造可信任的人工智能系統,意味著系統需具備內在的、可驗證的、符合人類價值觀的可靠品質。這不僅僅是技術問題,更是涉及技術、管理、法律、倫理的系統工程。

在此背景下,人工智能行業應用系統集成服務將迎來深刻變革與巨大機遇:

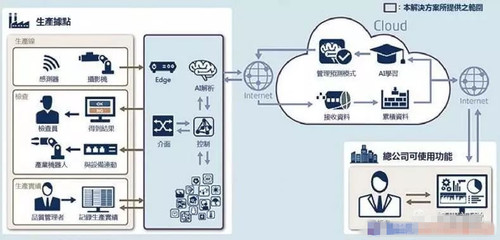

- 服務內涵升級:未來的系統集成服務將超越傳統的軟硬件整合,演進為“可信AI解決方案集成”。服務商需要為客戶提供涵蓋可信需求分析、可信技術選型與集成、合規性設計、可信度評估與認證、持續監控與優化在內的全棧服務。

- 關鍵能力重塑:服務提供商需要構建三方面核心能力:一是對金融、醫療、制造等垂直行業業務邏輯與合規要求的深刻理解;二是掌握多種可信AI技術與工具鏈,并能根據場景靈活配置;三是建立涵蓋倫理、法律、安全專家的跨學科服務團隊。

- 市場價值凸顯:隨著法規趨嚴和用戶期望提升,能夠提供“即裝即信”或“可證可信”AI解決方案的集成服務商,將幫助客戶顯著降低合規風險、加速產品上市、贏得用戶信任,從而在市場中構筑強大的差異化競爭優勢。

- 平臺化與生態化:可能出現專注于可信AI的中間件平臺和生態系統,提供標準化的可信功能模塊(如公平性檢測工具包、模型解釋服務接口)、共享數據集和測試環境,賦能廣大集成商和開發者高效構建可信應用。

2020年是全球可信AI發展的關鍵一年,奠定了從理念共識走向實踐落地的基礎。面向唯有通過持續的技術創新、健全的治理、負責任的實踐以及專業化的集成服務,才能真正鍛造出值得信賴的人工智能,釋放其普惠于社會的全部潛能。

如若轉載,請注明出處:http://m.0b00.cn/product/39.html

更新時間:2026-02-24 03:28:25